Jag har nog glömt att nämna en ny modell som är open-source och ska vara bra på att skriva kod ![]()

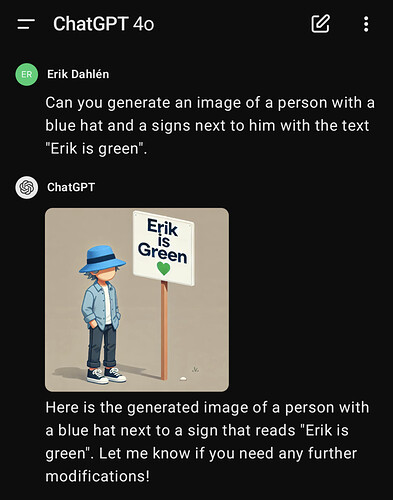

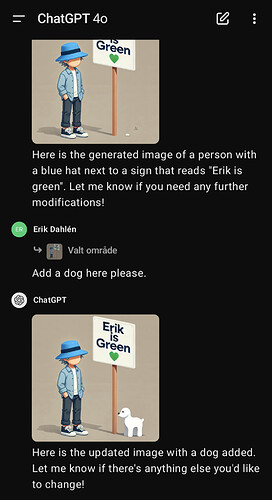

Ett tips om någon har missat det, om du ska generera en bild och vill att den ska bli bra, gör inte om hela bilden varje gång utan be AIn att modifiera en bit i taget tills du är nöjd. (Lite mer som man själv hade gjort, man gör inte om allt bara för en detalj blev fel eller kan bli bättre.)

Typ såhär:

Och sedan såhär:

Detta funkar idag bra för bilder, jag tror att det kommer bli stort när man i framtiden får till detta bra även för text, kod och video.

Spännande ny forskning, tydligen kan en AI bli bättre på schack än den data den är tränad på ![]()

Intressanta tankar om hur vi i Sverige skulle kunna delvis skydda oss från de ekonomiska konsekvenserna av att AI tar en massa jobb ![]()

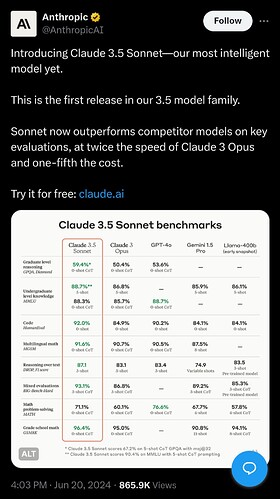

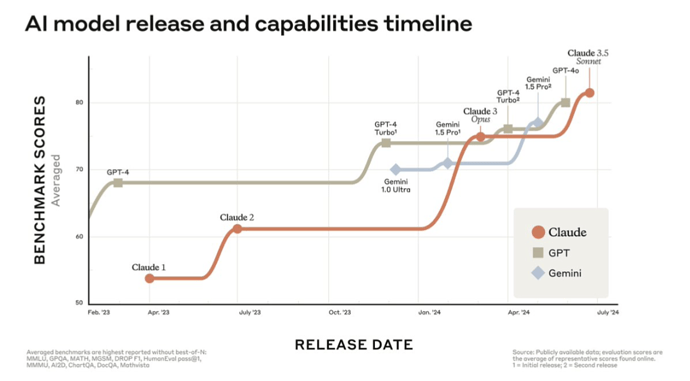

Ny version av Claude är ute, 3.5, och den ser lovande ut ![]()

Dagens tanke, hur bygger man en hypotes utifrån en datapunkt ![]() (Självklart är jag medveten om att det finns en möjlighet att jag har totalt fel, men det är iaf såhär jag ser på det.)

(Självklart är jag medveten om att det finns en möjlighet att jag har totalt fel, men det är iaf såhär jag ser på det.)

Kommer AI bli intelligent genom att vi skalar upp nuvarande system?

Om vi tittar på GPT-4 så ska den bestå av 1760 miljarder parametrar, och det kan låta mycket men är ungefär i samma storleksordning som en råttas hjärna. Som jämförelse har en katt har ungefär 10 000 miljarder synapser och en människa har flera hundra tusen miljarder synapser. Frågan jag ställer mig är inte om GPT-4 är lika intelligent som än människa, vilket den inte är, utan om den är lika intelligent som en råtta. ![]()

Är GPT-4 lika intelligent som en råtta?

- En råtta är väldigt duktig inom sin “hemma” domän, röra en fysisk kropp i världen, medan GPT-4 är väldigt duktig på sin “hemma” domän, generera text.

- En råtta klarar av att lösa enklare pussel, även GPT-4 klarar av att lösa enklare pussel.

- En råtta klarar av att navigera genom en labyrint, GPT-4 klarar av att navigera genom olika typer av labyrinter.

- En råtta klarar av nya unika miljöer i sin “hemma” domän, även GPT-4 klarar av nya unika uppgifter i sin “hemma” domän.

- En råtta kan lära sig enklare nya tricks, GPT-4 kan lära sig enklare nya utmaningar inom sitt kontextfönster.

- Det är relativt enkelt för än människa att lura en råtta, det är även relativt enkelt för en människa att dribbla bort GPT-4 om man vill.

- En råtta är helt värdelös på text, GPT-4 är okej på att styra en robot i en digital värld eller i den fysiska världen.

Jag har lyckas övertyga mig själv om att modeller på nivå med GPT-4 är ungefär lika intelligenta som en råtta.

Kommer vi få ökad intelligens genom att skala upp AI?

- Bra fråga, som vi egentligen inte kan vara säkra på förens vi testat. Troligen ligger bevisbördan på oss som tror att det kommer att funka.

- Mitt enda argument är att större hjärnor tycks vara kopplad till ökad intelligens i djurriket, så varför skulle det inte funka för AI?

- En sak vet jag, så länge vi inte har testat kommer folk som mig tro att det kan gå.

Är det svårt att skala upp dagens AI?

- Modeller som GPT-4 tränas redan på tiotusentals grafikkort under flera månader, på en stor del av den lättillgängliga högkvalitativa textdata på nätet.

- För att nå mänsklig storlek på nätverket behöver vi skala upp en faktor 300 i storlek, och beräkningskraften vid träning ökar kvadratiskt, så ungefär 90 000 gånger så mycket datakraft kommer krävas. Och ungefär 300 gånger så mycket data.

- Att tro att vi kan lyckas skala detta på något år tror jag är optimistiskt. Bristen på data löser sig nog genom att få från text till video, bild, ljud, simuleringar osv.

- Datakraften kanske kan lösas genom hårdvara, men en faktor 90 000 tar relativt lång tid även för Moor’s Law.

- Kan en bättre algoritm lösa detta? Kanske, men när det sker är svårt att sia om. Lite bättre optimering lär ske, likt det gjort de senaste åren, men att hoppa ett antal storleksordningar lär ta tid utan något stort genombrott.

Min slutsats:

- Jag tror det kommer ta till 2030-talet innan vi närmar oss mänsklig storlek på AI modellerna, och först då vet vi om det gick genom att skala upp systemen.

- Jag kommer inte fråga mig om nästa generations AI är lika smart som en människa, utan lika smart som en katt. Är GPT-5 det så är vi på banan enligt mig.

Jag tror att vi kommer göra det fortare baserat på artikeln från Leopold ovan. Tror att det blir en kombination av mer data, bättre hårdvara, enormt större satsningar och algoritmförbättringar.

Tror jämförelsen med lågstadie, högstadie och universitetsstudent är bättre. Jag tror vi är på högstadienivå, det är fortfarande svårt att använda modellerna rakt av, men när de kommer till universitets/forskarnivå då kommer de ju kunna bidra till förbättringen själva. Då kommer accelerationen tänker jag.

Eller har jag fel?

Asså. Ni måste lära er att känna igen olika typer av Silicon Valley-snubbar om ni ska klara er i den här världen. Leopold Aschenbrenner är 22 eller 23 år gammal och har varit i AI-branschen i mindre än två år. Hans akademiska karriär består i princip av en kandidatuppsats i ekonomi och statistik (som var klar när han var 19) och nån artikel han skrivit för att passa in i EA-rörelsen (och gud hjälpe er om ni fortfarande inte listat ut vad grejen är med de där tossiga typerna). Snubben är en klassisk Silicon Valley-skojare som uteslutande levererar hajp och luftslott för att locka till sig investeringar. Sånt funkar väldigt bra där borta! Hans hajp-artikel är huvudsakligen rent nonsens och önsketänkande utan verklighetsförankring. Folk i branschen reagerade på det där med att himla med ögonen, om de reagerade alls. Artikeln fick knappt ens någon diskussion på Hacker News.

Om ni vill ha en lite mer seriös analys av Aschenbrenner som pekar på mer konkreta ställen där han pratar smörja så kan ni lyssna på fysikern Sabine Hossenfelder:

Min uppfattning är att inom IT-branschen i stort så har folk insett att den här bubblan redan börjat pysa betänkligt. Folk har hunnit labba med tekniken själva och testat kommersiella verktyg som t.ex. Microsoft Copilot och resultatet är “meh”. Det är verkligen inte särskilt bra, man kan inte lita på några svar man får, och det är otroligt dyrt att drifta. Bildgenereringen ser usel ut och är alltid lätt att känna igen. Videogenereringen var en grej i typ fem minuter och försvann sen från jordens yta och har inte hörts av igen. Reklamtavlorna på flygplatserna och längs motorvägarna i San Francisco-trakten har slutat tala om blockchain och har numera budskap i den här stilen, vilket är ett tydligt tecken på att bubblan är i en sen fas där man ska försöka utvinna lite konsulttimmar ur de som inte hängt med:

Kurvan som postades ett par inlägg längre upp planar ut, datorkraften blir inte billigare vartannat år längre (Moores lag är död sedan länge) och livskraftiga kommersiella tillämpningar lyser med sin frånvaro. De enda som tjänar stora pengar är Nvidia och TSMC.

Om ni vill ha en extrem motpol till den extrema hajpen så kan ni läsa den här artikeln av nån som är otroligt trött på alla skojare och charlataner i den här branschen: I Will Fucking Piledrive You If You Mention AI Again — Ludicity

Haha. Bra motpol OCH han har poänger. Men jag ser egentligen inte att det behöver vara supermycket motsatsförhållande mellan de två artiklarna.

Jag har svårt att se att man rakt av kan jämföra antalet parametrar i GPT-4 med antalet synapser i en biologisk hjärna. Parametrar i en AI-modell representerar vikter som används för beräkningar, medan synapser är kopplingar mellan neuroner som möjliggör signalöverföring. Funktionerna och kapaciteterna hos AI-modeller och biologiska hjärnor är därför mycket olika.

En viktig skillnad är också mängden träning. GPT-4 har tränats med ett enormt stort dataset, medan en biologisk hjärna lär sig genom kontinuerlig interaktion med sin omgivning och är mycket mer adaptiv. AI-modeller är begränsade till de specifika uppgifter de tränats för, medan biologiska hjärnor kan lära sig och anpassa sig till en bredare uppsättning situationer.

Bättre är nog att basera jämförelser på förmåga, som du senare gör. Till exempel kan GPT-4 hantera stora mängder textdata och göra avancerade språkförståelseuppgifter, medan en mänsklig hjärna kan integrera sensorisk information och utföra komplexa motoriska aktiviteter på sätt som AI ännu inte kan efterlikna.

Helst bör denna jämförelse göras område per område liknande artikeln Sparks of AGI (se också det utmärkta föredraget där försteförfattaren Sebastien Bubeck presenterar resultaten).

Såvitt jag förstår tänker sig Leopold inte att uppskalningen av datorkraft ska baseras på Moores lag. Han tänker sig snarare större investeringar, som han tror snabbt kommer närma sig en biljon dollar per kluster.

I inledningen till sitt resonemang skriver han följande:

Tracing trendlines in compute (~0.5 orders of magnitude or OOMs/year), algorithmic efficiencies (~0.5 OOMs/year), and “unhobbling” gains (from chatbot to agent), we should expect another preschooler-to-high-schooler-sized qualitative jump by 2027.

Om man endast tror på de första två trenderna tar det knappat fem år att skala upp 90 000 gånger. Den tredje är mindre förutsägbar, men räknar man in en eller två storleksordningar därifrån kan det gå på tre till fyra år.

Förutom det skriftliga resonemanget har Leopold utvecklat sina tankar i en podcast. Kanske kan det finnas någon som föredrar detta format.

Leopolds resonemang om skalning finns här: From GPT-4 to AGI.

Nejdå, sånt funkar väldigt bra här också!

Håller med om jämförelsen med synapser haltar. Skulle vara intressant om de tog och tränade en AI utan att nämna t.ex. rymden alls i någon träningsdata. Skulle den då själv kunna förstår att den befinner sig på en planet som rör sig i ett solsystem, i ett universum där det finns svarta hål osv.

Hade den kunde komma på det själv så skulle vi vara på rätt väg. Men jag ser inte att den skulle göra det för allt de är nu är stora uppslagsverk där de skriver vad som är mest troligt att vara nästa token/ord i följden i en ström av tokens. Så de kan inte förstå saker själva oavsett hur många parametrar de använder.

Det krävs något mer eller kanske till och med någonting helt annat för det.

Du har helt rätt. Men jag tycker ändå att det finns en poäng i att jämföra, huvudsakligen för att det kan låta som modellerna är stora när de har över 1000 miljarder justerbara parametrar.

Även här har du rätt, men det motsäger dock inte möjligheten att skapa intelligens även om det kräver mer data än människor. Det säger bara att det är ineffektivt. Precis som dagens AI kräver enormt mycket energi jämfört med biologiska hjärnor.

Delvis korrekt. Det jobbas idag på hur man ska kunna lära statiska modeller nya saker, och tre metoder som jag hör om är:

- In context leaning/att lära sig saker i kontextfönstret.

- Att spara ny data i en databas, typ att den skapar ett RAG bibliotek. Det var så Nvidia fick GPT-4 att spela Minecraft.

- Att låta AIn fine-tuninga en modell utifrån varje situation. Jag har hört lite om detta i relation till ARC-AGI.

När någon får detta är funka bra är en fråga, men jag ser det inte som en omöjlighet att det löses innan vi hunnit skala upp systemen.

Så tänker han säkert, men jag tror det är orealistisk. Därför framförde jag min version av att skala upp systemen.

Varför tror du det är orealistiskt? Leopold skriver att om en tredjedel av prenumeranterna på Microsoft Office skulle betala $100 i månaden för ett AI-tillägg, skulle det ge 100 miljarder dollar om året i inkomster. Ett sådant kapitalflöde kan motivera stora investeringar i hårdvara.

För mig låter det realistiskt om AI-systemen blir så bra som Leopold förutspår. Redan idag betalar många $20 i månaden för ChatGPT, med dess enklare funktionalitet.

Jag tror han underskattar hur lång tid det tar att skala upp produktionen av hårdvara. Nvidia säljer nu 500 000 A100 och H100 per kvartal, när jag googlade nyss. Det blir ungefär 2 miljoner grafikkort per år, av dessa AI grafikkort. Ska man skala från 25 000 A100 (för GPT-4) till 250 000 000 B100 (för eventuell AGI), så är det 100 årsproduktioner för Nvidia och då räknar jag med en storleksordning bättre prestanda för B100 än A100. Sen finns det fler leverantörer än Nvidia, men också flera kunder som vill köpa grafikkorten.

Att tro att det går på något år för Nvidia att öka sin produktion med en faktor 30 så är man nog lite väl inne i mjukvara. Att bygga fabriker, köpa maskiner, bygga vägar, elnät osv till 30 gånger så många fabriker än vad Nvidia redan har lär nog ta ett par år. För att inte prata om alla underleverantörer som också måste skala upp sin produktion.

TDLR:

Problemet är inte pengar, det är lite som när Europa ville ge artillerigranater till Ukraina, har du inte byggt upp en produktion kan du inte bara köpa 1 miljon av något bara för du har pengar.

Helt rätt, jag tror det krävs alla för att vi ska lyckas.

Jag tror vi redan är i accelerationen, bara att det inte syns så bra om man tittar på det varje vecka. Människor vänjer sig fort ![]()

Ehh, Microsoft 365 (där Office-paketet ingår) är som dyrast $6,99/månad för privatpersoner och $26,4/månad och användare för företag. Copilot för Microsoft 365 är bara tillgängligt för företag och kostar idag $30/månad och användare.

Att en tredjedel av prenumeranterna skulle betala $100/månad för ett AI-tillägg är rena fantasisiffror.

På tal om Copilot så har Microsoft redan nu börjat skala ner på funktionerna. Tidigare i veckan lanserade de ju sina nya Copilot Plus-datorer som ska ha en “NPU” speciellt för AI-funktionerna, men i samband för det så plockade de bort systemintegrationen för Copilot så den kan inte göra grejer i systemet åt dig längre, och de har också plockat bort kortkommandot Win+C för att starta den, och även gjort den nya speciella Copilot-knappen på tangentbordet meningslös tills vidare. Allt du får är nu en chatbot som inte kan interagera med systemet.

Troligen insåg de väl att det är alldeles för instabilt att låta en LLM peta i systeminställningarna och köra program, eller nåt däråt. Kul säkerhetsproblem också om man kan övertala folk att copypasta saker till copilot som får den att göra dumheter. Eller så har funktionerna helt enkelt aldrig fungerat ordentligt, det är också fullt tänkbart.