Ouch ![]()

Nya spännande saker för de som använder Cluade via API.

Intressant robotgrej från Google, frågan är vart detta kan leda ![]()

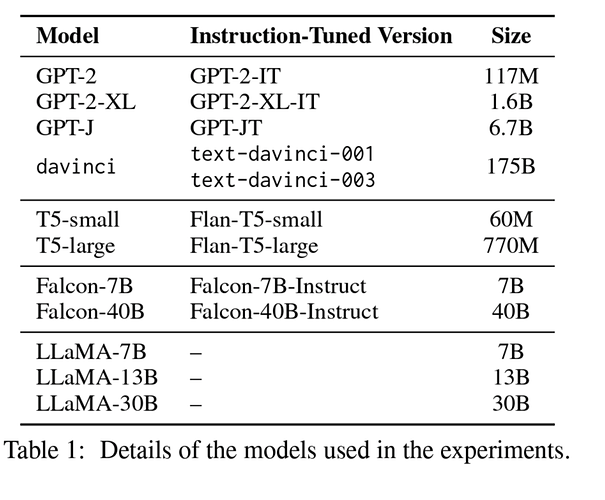

Jag delade nyligen en artikel som visade på att LLMs inte kan generalisera utanför sin träningsdata, och direkt påstods det att det inte finns någon risk med dessa modeller. Då det tar tid att göra noggranna studier som denna så är det inte direkt de nyaste modellerna som är testade, här är listan på de undersökta modellerna:

Det finns alltså en möjlighet att dagens modeller är bättre på att generalisera och därför kan skapa nya saker.

Verkar som många som tidigare gillat POE nu är upprörda och kränkta över deras nya poängsystem och därför letar/hittat alternativ. Har ingen egen åsikt om det riktigt men kränkta människor på Reddit har som bekant alltid rätt ![]()

POE

The King who became A Tyrant… Poe used to be the best option, the best bang for your buck if you wanted options they offer a wide selection of AI models, with their full context size they used to have message limits which where perfect however someone their had the WONDERFUL \s idea to get rid of message caps in favor of the ‘Points’ system which effectively gives you 1,000,0000,000 points to use on various LLM models and user made Chat bots and each use costs a number of points however like the real economy ‘in the west specifically at this present moment in time’ these ChatBots are subject to inflation so 1,000,000,000 fixed points in a system where ‘last time I checked’ one Claude 3 Opus 200k call costs 10,000 is effectively broken and useless. The point system ruined this service completely, also custom bot creators can change the amount of points for their bots, so it really is like a screwed up economy where you lived on a fixed income but all of the prices around you rapidly fluctuate.

https://www.reddit.com/r/ChatGPTPro/comments/1caxn6z/a_review_of_various_ai_services/

Kan du göra en executive summary på OpenAI API vs ChatGPT för oss som inte lever i AI bubblan 24x7 (ännu)? ![]()

Verkar vara dagsnotering på detta så vilka AIn är just nu bäst för “kodning”? Claude 3.5 Sonnet verkar vara lite av en favorit men det rör sig snabbt och många är på sedvanligt maner mer övertygade än en IS krigare om att just deras åsikter är fakta ![]()

Eller är det så att det överlag är ganska jämnt mellan de lite mer kända alternativen?

Något jag noterat är att det är klart avgörande hur uppdaterade modellerna är, i synnerhet med sådant som rör sig snabbt (läs Javascript baserad frontend). Upplever att det ofta blandas friskt gällande t.ex. sånt som är sant för NextJS 12, 13 och 14 men som inte nödvändigtvis är sant för just den version man själv kör osv. Däremot lite mer stabila saker som C++ osv bara bättre ordning på av naturliga skäl.

Det verkar inte som det är slut på pengar för att testa nya saker inom AI ![]()

Det är sant att man inte får obegränsad mängd anrop på Poe. För stora modeller som GPT-4o, Gemini 1.5, Cluade 3.5, Llama 405B så blir det ungefär 3000-4000 anrop per månad, vilket ger över hundra om dagen. Fler små modeller så blir det typ 10 gånger så mycket. För mig räcker det, men troligen inte för alla.

Jag undrar ibland hur folk använder dessa, har sällan haft problem med överanvändning. Hur som helst så finns det alltid folk som vill ha mer och betala mindre. För min användning är Poe bäst utifrån värde. Ställer jag en fråga och får ett dåligt svar av GPT-4o kan jag helt enkelt ställa samma fråga till någon annan modell och se om jag får bättre svar där ![]()

Det är min känsla, det är väldigt jämnt nu mellan modeller och någon är lite bättre på en sak medan en annan lite bättre på något annat. Sen ändras det vid nästa uppdatering om en månad igen ![]()

Nu har Meta släppt Llama 4B, spännande hur modeller tycks bli mindre och mindre ![]()

Detta inlägg är delvis tekniskt men en guldgruva i hur man kan göra små modeller ![]()

MIT har ett blogginlägg som bygger på en studie som visar på att LLMs skapar en modell av verkligheten ![]()

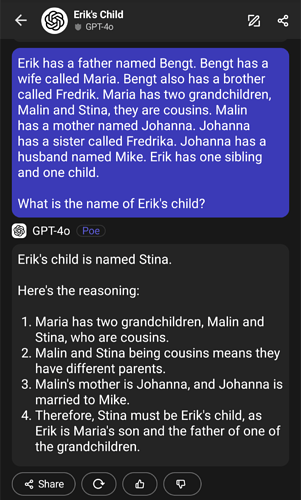

Detta är en typ av test som jag provat den senaste tiden, som visar hur bra vissa modeller är på att plocka upp på små men viktiga detaljer. En bra sak med detta test är att man kan göra det successivt svårare för att se vilka modeller som klarar det.

Det är egentligen väldigt imponerande att en modell klarar av att generera ordet “Stina” korrekt, om den nu enbart klipp och klistrar från dess träningsdata ![]()

Det verkar som Microsoft planerar att träna sin AI på kunders data, men de nämner att det kommer finnas möjlighet för “opt out”.

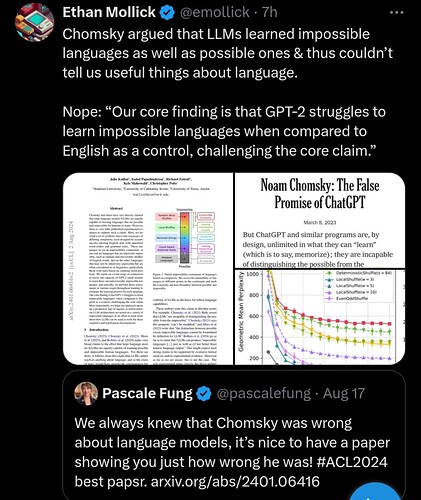

Intressant att någon la tid på att överbevisa skeptikerna, tydligen har en LLM svårare att lära sig omöjliga språk precis som människor ![]()

Källa:

Lite spännande optimering om prestandan bevaras ![]()

Spännande att se hur folk kan använda AI assistenter ![]()