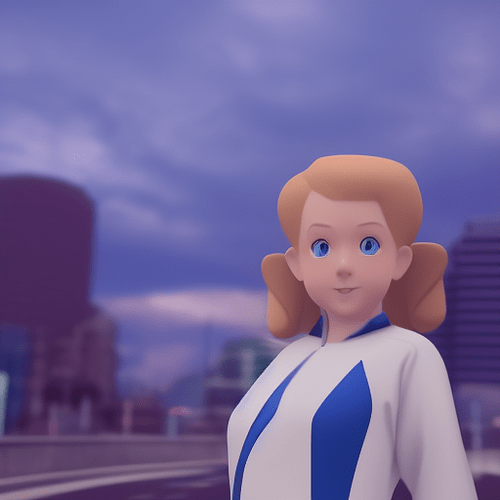

Jag genererade den här bilden med Stable Diffusion och Epic Diffusion-modellen nu:

Du kan dra bilden in i automatic1111 i fliken som heter “PNG info”, så får du alla inställningarna som användes för att genera bilden (jag har ställt in mitt automatic111 att spara inställningarna som en tag i bilden). Sedan kan du klicka “send to txt2img” så skickar den alla inställningar inklusive seed till den fliken. Då borde du kunna generera exakt samma bild som jag, om du har samma modell och annat i övrigt.

EDIT: Forumet förstör bilden på något sätt, så den sparade taggen försvinner (antagligen anonymiserar forumet bilderna så man inte ska råka ge folk sina gps-koordinater som ofta sparas i bilderna av telefoner).

Jag kör dock med “–xformers” som argument när jag startar webgui, och det sägs att den inte alltid generar precis samma bild varje gång då, så vore intressant att se om du får samma

Så här säger PNG info för mig:

parameters

hyperrealism movie shot of white young girl with blue eyes as superhero with suit in pokemon city night theme,

dynamic pose, in action, standing,

bustling city, people on street in detailed background, rainy street, fog,

bokeh,

full body

Steps: 90, Sampler: Euler, CFG scale: 7, Seed: 3533463320, Face restoration: GFPGAN, Size: 768x512, Model hash: ee6266109f, Model: epic-diffusion, Denoising strength: 0.75, Mask blur: 4

OBS: Jag gjorde inpaint på ansiktet för att snygga till det (vanligt trick), så det som syns där är inställningarna för inpaint-genereringen, men det är samma inställningar som jag körde på hela bilden först.

Edit: Dock hade jag tydligen glömt att låsa seed, så seed för första körningen skiljde sig och var: 897205273

![]() Tänk så roligt att få ge det i present haha eller om man ger till vänners barn etc. Helt sjukt! Älskar tanken.

Tänk så roligt att få ge det i present haha eller om man ger till vänners barn etc. Helt sjukt! Älskar tanken.![]()