intressant! Jag skulle vilja ha en robot som underhåller, felsöker och reparerar andra prylar, alltifrån fordon till elektroniska gadgets. När får vi se dylika robotar?

Skulle jag gissa så tror jag att vi kan dra en del lärdomar från både självkörande bilar och chattbottar.

- Jag tror att robotar är ungefär där självkörande bilar var under 2010-talet, coola demos men inte riktigt redo för verkligheten.

- Jag tror att robotar kommer börja rulla ut kring år 2030, likt Waymo rullar ut nu. Inte överallt för alla ändamål på en gång.

- I slutet av 2030-talet kommer det vara tillräckligt bra och billigt så du verkligen kan se dem i var stad och fabrik. Lite likt att ska har tillgång till en chattbot idag.

Lite spännande information om hur bra en del modeller är på den senaste versionen av matte olympiaden ![]()

Aldrig typ, gissar jag. Förmodligen inte kostnadseffektivt att producera något så generellt.

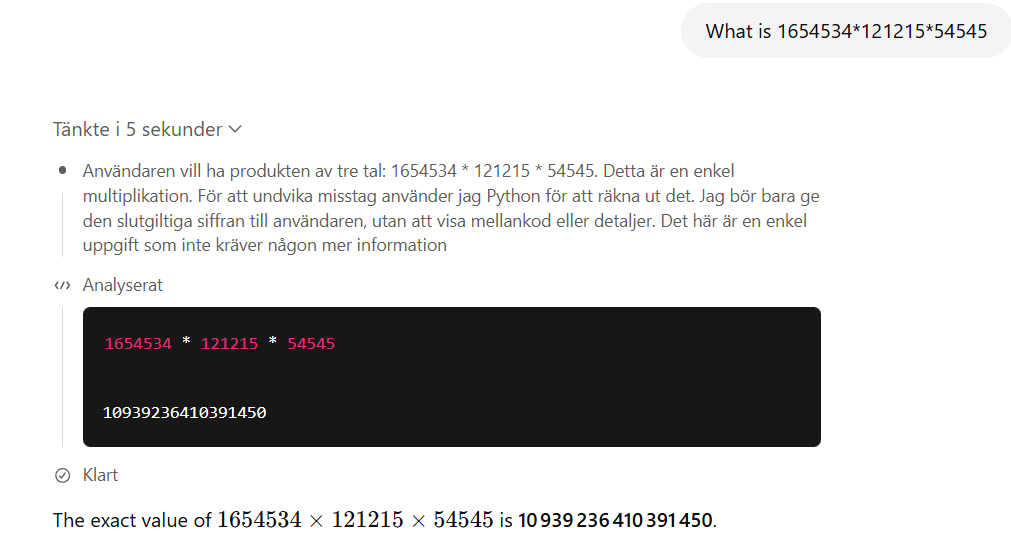

Insåg idag hur dålig AI (eller åtminstone chatgpt) fortfarande är på grundläggande matte.

Bad den att multiplicera ihop tre heltal och det tog den tre försök att komma fram till rätt svar.

Skulle inte AI bara kunna använda en miniräknare istället för att gissa hej vilt? ![]()

Den som lever får se, men jag tror du har fel.

Jag tror generella system blir mer effektiva i längden, mindre specialiserade system kan massproduceras billigare. Exempelvis har generella maskiner som persondatorer och smartphones blivit enormt kostnadseffektiva.

Även inom andra områden är flexibelt lönsamt. Det är inte ovanligt att det är billigare för två personer att köra bil till en destination än att flyga, åka tåg eller ta en färja.

Industrirobotar idag är troligen effektivare än generella AI robotar, men flexibilitet är också en fördel. Du kan inte säga åt en industrirobotar vars verktyg gått sönder att gå över till byggvaruhuset och köpa en ny hammare/såg/skruvdragare. Flexibilitet kan absolut visa sig vara mer kostnadseffektivt.

En fördel till med en robot som kan göra allt är att man behöver inte specialbygga varje industrirobot, man behöver inte en ingenjör som planerar installationen av varje robot, man kan skala upp produktionen likt den idag fungerar för mobiler.

Det gör de redan, problemet i nuläget är mest att man som användare måste förstå vilka system som gör vad. chatgpt t.ex är från början inställd att vara en ren chatmodell så man måste explicit byta till resonerande varianten.

Gemini går direkt till python

Hur går det till?

I chatgpt byter du till de olika varianter som finns i verktyg (tänk längre, deep research)

Ok, man verkar behöva logga in för att kunna göra det. Jag testade lite utan inloggning. Ganska beklämmande resultat.

Men är det inte ganska självklart att om man använder ett system som inte kan komma åt verktyg så kan man inte förvänta sig ett korrekt resultat på stora aritmetriska beräkningar, eller vad menar du är beklämmande.

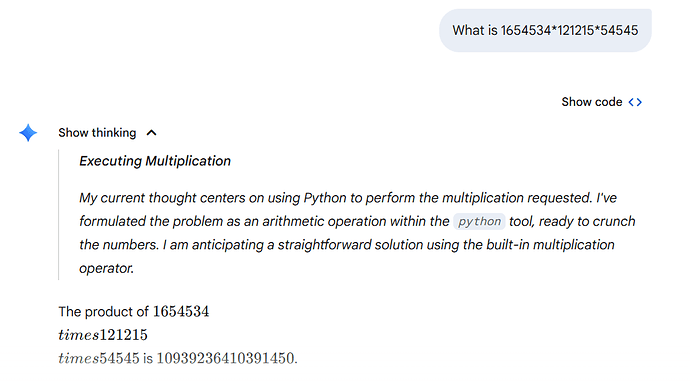

Det tycks som det har kommit en ny och tredje version av Arc AGI.

Länk:

Spännande och se hur fort de kommer ut med nya och ännu svårare test för AI. Min känsla är att förespråkarna för Arc AGI gick runt förra året och hävdade att AGI var långt borta då ska modeller var dåliga på Arc AGI 1, och kände sig nöjda med det. Men sen kom o3 och chockade dem, så det senaste halvåret har de nu kommit med 2 allt svårare versioner. Ska bli intressant och se hur länge det fortsätter ![]()

Det tycker jag inte. Det har inte framgått på något sätt att det finns olika modeller med olika kapacitet då jag har interagerat med ChatGPT, utan det är något jag blivit varse om här i tråden.

Istället spottar grundmodellen, för användare utan inloggning, ur sig svar som den bara gissar sig till, trots att modellen påstår att den räknat rätt, den här gången, då man påtalar fel. Men visst, det är tillåtet att tycka olika om AI-tjänsters interaktion med användarna och här har vi uppenbarligen olika åsikter.

Kritisk artikel från Realtid i går.

Och ändå är vi här där människor använder LLMs till allt möjligt även om det är fel verktyg för det.

Beräkna, uppskatta, råd om investeringar, råd om medicin, etc etc

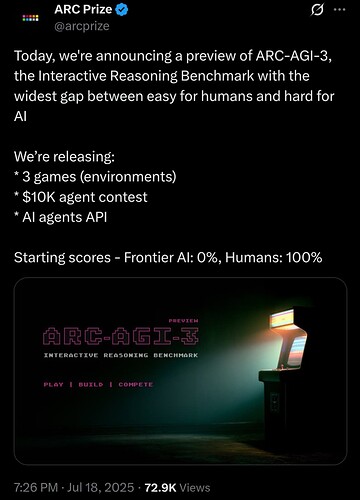

Spännande nya modeller från Nvidia ![]()

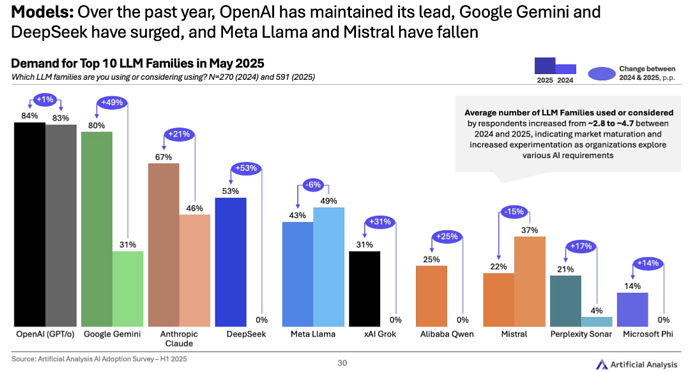

Jag tycker det blir allt tydligare att vi står inför en stor utbildning av folk, för att lära sig om hur dessa system fungerar. Exempelvis som det står här:

Pwrteams, som har kartlagt AI-projekt globalt, konstaterar att endast 7 procent av arbetskraften är verkligt skickliga på att använda tekniken på ett sätt som ger tydliga produktivitetsvinster.

Eller när du nyss insåg att man måste välja olika modeller för olika saker.

Det är helt korrekt ett kommunikationsproblem från leverantörerna, jag har aldrig påstått att jag tycker interaktionen är bra. I fallet chatgpt har det nästan blivit en meme på hur snurrig hela deras uppställning är med olika system som är bra på olika saker, olika namn på olika delsystem, versionsnummer som hoppas över, och versioner som dras tillbaka. Hela marknaden är extremt ung, det är ju en alphaversion vi ser av allt som levereras, och både användare och leverantörer är fortfarande ganska nyvakna.

Jag håller inte riktigt med - han säger fortfarande att AGI är lika långt borta. Det är extremt svårt att göra tester av modellers generaliseringar som är tidlösa. Antalet givna tester som modellerna tränas på (samt system med experter etc.) har ökat snabbt de senaste åren. Syftet med ARC är att knuffa forskningen/tillverkarna i rätt riktning. Han har aldrig sagt att han är bäst på att skapa rätt tester men han gjorde det eftersom ingen annan verkade intresserad av att “göra rätt”. Istället för generalisering fokuserar de flesta på att träna upp modellerna på fler specialicerade tester/uppgifter.

Däremot skulle man kunna argumentera för att en annan uppfattning har förändrats, nämligen nyttan av AGI - eller snarare nyttan med LLMer 2025. Om vi faktiskt kan skala oändligt så blir det en slags process där vi lär modellerna en sak i taget. Och det kommer vara väldigt användbart. Det är redan användbart för vissa uppgifter.

Men det har egentligen inte med AGI att göra. Anthropics vending machine gav ett mer lättförståeligt exempel på att samma inneboende problematik kvarstår som vi AGI-skeptiker hävdar är symptomatiskt för dagens LLM-teknik. Oavsett skalning. Det kanske var ett bättre test av generalisering. Men nu kommer Anthropic träna nästa modell på detta och vips så är det ett dåligt test - för den nya modellen kommer fortfarande inte fungera om den ska agera biljettlucka. För många edge cases. Men den kan agera vending machine. Om man hade användning för en vending machine så är det kanon, men ur AGI-synpunkt har man inte tagit sig framåt.