En spännande artikel, hur mycket bättre blir AI agenter på att modellera verkligenheten i takt med att de blir större och får mer beräkningskraft, tydligen följer det liknande kurver som för text ![]()

Någon har försökt sig på att experimentera med “test time training”, liknande men ändå annorlunda mot o1, spännande vad folk testar ![]()

The Rundown: OpenAI CEO Sam Altman just predicted that artificial general intelligence will be achieved in 2025, coming alongside conflicting reports of slowing progress in LLM development and scaling across the industry.

The details:

In an interview with YC founder Gary Tan, Altman said the path to AGI is ‘basically clear’ and will require engineering, not new scientific breakthroughs.

A new report revealed that the rumored ‘Orion’ model shows smaller improvement over GPT-4 than previous generations, especially in coding tasks.

The company also reportedly formed a new “Foundations Team” to tackle fundamental challenges, such as the scarcity of high-quality training data.

OpenAI researchers Noam Brown and Clive Chan backed Altman’s AGI confidence, believing the o1 reasoning model offers new scaling capabilities.

Why it matters: Altman’s prediction would mean a drastic leap in the company’s AGI scale (currently level 2 of 5) — but the CEO has remained consistent in his confidence. With OpenAI suddenly prioritizing o1 development, it makes sense that the reasoning model might have shown new potential to break through any scaling limits.

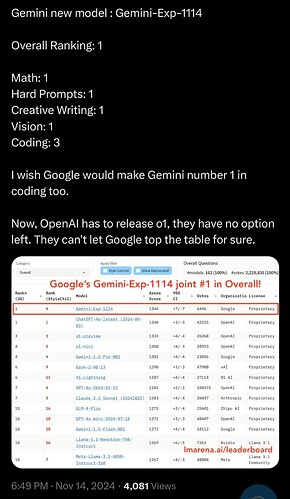

The race is on ![]()

![]()

![]()

![]()

Jag tror också det är ett rent engineering problem och inga betydande vetenskapliga framsteg behövs. Men det är inga småjobb att integrera reasoning med språket, och sedan world modelling med reasoning.

Popcorn ![]() hela vintern då med andra ord

hela vintern då med andra ord

Ryktet som flödar just nu är att LLMs har nått sin gräns. Ska bli spännande och se vad som händer de närmaste månaderna. Om även Llama 4 och Grok 3 misslyckas kan vi nog dra slutsatsen att det var svårare än man trodde.

Ja, det kan nog bli så till slut. Det kluriga framsteget kommer via Strawberry liknande designs tror jag.

Att vara övermänsklig på språk men undermänsklig på logik går nog inte hela vägen ![]()

Absolut, det räcker att man kommer på 1 metod för att skapa kraftfull AI för att det ska fortsätta. o1 är nog det mest lovande just nu.

Ja, RL som o1 bygger på är lovande. Även andra mer formella eller symboliska vägar till logik går att tänka sig. Super spännande engineering issue.

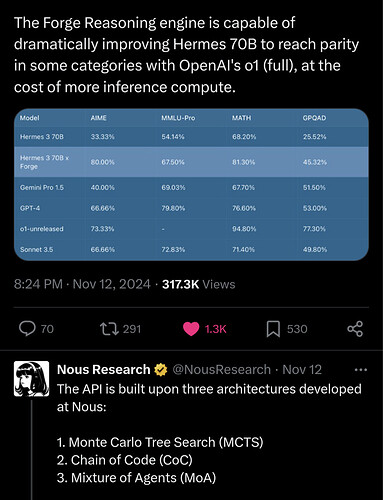

På tal om att o1-typ av system kan vara vägen framåt så har någon gått ut med en ny metod för test time compute ![]()

“OpenAI, Google and Anthropic Are Struggling to Build More Advanced AI”

Konstigt att de tycker att det är brist på träningsdata som är felet. Har man mer eller mindre hela internet att träna på så tycker man det bör räcka. Kan du träna på alla kod i hela github så hur kan X% mer kod hjälpa när du redan har miljarder rader? Det är inte så att vi människor behöver det för att lära oss.

De behöver nog komma på ett nytt genombrott i hur de använder datan istället, vilket de säkert lär göra. Frågan är bara när.

Lite statistik över hur företag använder AI agenter ![]()

Inte helt konstigt, det är välkänt att AI kräver fler exempel för att förstå något än människor. Frågan är bara om vi kommer lyckas hitta tillräckligt med data för att uppnå AGI eller inte.

Man kan sammanfatta för- och nackdelen mellan människor och AI ungefär såhär:

- Människor lär sig fort, med lite data.

- AI lär sig långsamt, men när de väl kan något så kan man lätt kopiera det. (Bland människor så måste alla ta körkort själva, när vi har en AI som kan köra bil så kan den köra alla bilar samtidigt.)

Så kan det bli. Genombrott är dock svåra att tidsestimera.

Lex Fridmans senaste podcast är lite drygt 5h, men mycket intressant.

Delarna om AI-säkerhet är skrämmande och oerhört intressanta. Dario pratar om att vi kanske ex måste förbereda oss på frågan “hur ska vi veta om en AI blir för smart, och försöker blåsa oss genom att spela dum?”

Låter imponerande, lika bra att få ut så mycket som möjligt från grafikkorten ![]()

I Kina har de även robotar som kan springa, tydligen inte lönt att träna inför ett maraton ![]()

Någon som märkt en trend ![]() (AI bolagen hoppar snarare över EU än anpassar sig.)

(AI bolagen hoppar snarare över EU än anpassar sig.)