Detta är ett provprat:

Tanken kom i ett provprat med @janbolmeson, @Andre_Granstrom och @Per_Johan_Ohlsson och jag vill bara fortsätta diskussionen då jag kände att ämnet släpptes snabbare än jag lyckades bli talför pga att jag satt på tunnelbanan.

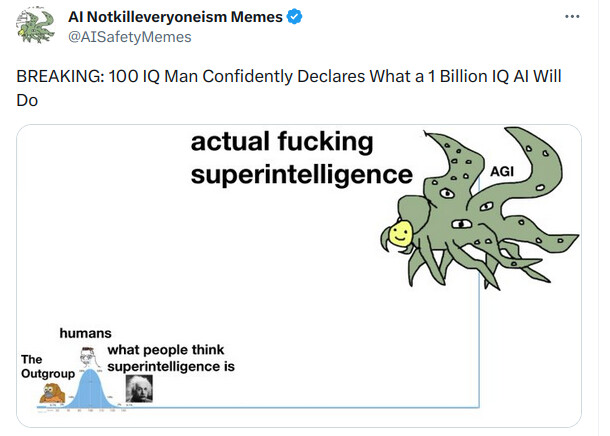

Så, vi har idag ett rudimentärt AI-verktyg, ChatGPT. Men det forskas massvis på AGI (= Artificial General Intelligence). Dagens ChatGPT har läst in sig på världen genom internet fram tills 2021 (med betalversionen är den online redan) och den kan spotta ur sig svar på ens frågor. Enligt Wikipedia är AGI:

“An artificial general intelligence (AGI) is a type of hypothetical intelligent agent. The AGI concept is that it can learn to accomplish any intellectual task that human beings or other animals can perform. Alternatively, AGI has been defined as an autonomous system that surpasses human capabilities in the majority of economically valuable tasks.”

Det här är ju bara början, så fort detta implementeras bredare kommer vi ha billiga assistenter som kan, egentligen, göra 95% av den mänskliga populationens arbete. Vi kan se filmer, lyssna på musik, se konst, skapade av AI redan idag.

Det jag kände var att dagens samtal var lite för inriktat på hur spännande och nytt allt skulle bli om den användes till godo. Och absolut. Det skulle vara fantastiskt.

Men vi människor har använt många uppfinningar hittills till att skada andra människor, och jag är rädd för AGI om den hamnar i fel händer.

Att styra aktie- eller trafikflöden för att få ekonomisk vinst eller ha ihjäl någon kommer inte vara ett problem. Vi pratar om något som har all världens kunskap och obegränsat minne för att minnas allt. Som vet allt vad vi vet.

Den vet allt Jan har sagt, vilken ton han har sagt saker med och kan utifrån det filtrera det den tror han har för lösenord och sedan försöka komma in i hans konton. Den kommer kunna ta reda på lösenordet till kärnvapnen i USA och Ryssland, eller så kommer den bara spela ut oss emot varandra. Långt hopp emellan vardera, men jag betvivlar att det kommer ta en AGI lång tid.

Jag vet inte vad jag tänker. Men att fundera på var man kan få störst ekonomisk vinst eller anta att den kommer användas enbart för gott tror jag är fel. Jag tror vi behöver se en global reglering, hur den ska implementeras och om den ens är av godo/nödvändig är trådens ämne.

Och sedan förstår jag att ni kommer invända med att AGI är långt bort, till er svarar jag:

Om den bästa tiden att plantera ett träd var igår, den näst bästa är idag så varför inte börja så tidigt som möjligt? Låt oss fundera över detta innan vi inte längre kan.